Wan2.2是什么

阿里巴巴最新开源的通义万相2.2(Wan2.2)是一个强大的AI视频生成模型,覆盖文本生成视频(T2V)、图像生成视频(I2V)以及统一视频生成(IT2V)三种能力,参数总量高达270亿。模型采用混合专家(MoE)架构,兼顾生成质量与效率,并首次引入电影级美学控制系统,能细致调控光影、色彩、构图等效果。

Wan2.2的主要功能

- 文生视频(Text-to-Video):根据文本描述生成对应的视频内容,例如输入“一只猫在草地上奔跑”,模型即可生成匹配的视频画面。

- 图生视频(Image-to-Video):输入一张图片,模型可将其“动起来”,生成连续的动态场景。

- 统一视频生成(Text-Image-to-Video):结合文本和图片信息,生成更精准、更丰富的视频内容。

- 电影级美学控制:支持通过关键词定制画面风格,如“暖色调”“中心构图”等,实现专业级的光影、色彩、构图和人物微表情控制。

- 复杂运动生成:可生成复杂的动作场景和自然的人物交互,让视频更具真实感与表现力。

Wan2.2的技术原理

- 混合专家(MoE)架构:模型引入高噪声专家与低噪声专家协同工作机制,前者负责整体布局,后者精修细节。在不增加计算成本的前提下,扩大参数规模,提升生成表现。

- 扩散模型(Diffusion Model):以扩散模型为基础,通过去噪过程逐步生成清晰的视频帧,与 MoE 架构结合,进一步优化效果。

- 高压缩率 3D VAE:采用高压缩比的三维变分自编码器,在时间与空间维度进行压缩,使得模型可在消费级显卡上快速生成高质量视频。

- 大规模数据训练:模型基于海量图像和视频数据训练,具备更强的泛化能力,能适应多样化场景需求。

- 美学数据标注:通过标注光影、色彩、构图等美学元素,模型能输出更具电影质感的内容,满足用户对风格和质感的个性化需求。

Wan2.2的项目地址

- GitHub仓库:https://github.com/Wan-Video/Wan2.2

- HuggingFace模型库:https://huggingface.co/Wan-AI/models

Wan2.2的应用场景

- 短视频创作:帮助内容创作者快速生成富有吸引力的短视频,用于社交媒体发布,节省制作时间与成本。

- 广告与营销:品牌和广告公司可借此生成高质量宣传视频,提升广告表现力和品牌影响力。

- 教育与培训:教育机构和企业能轻松制作生动直观的教学视频,增强学习效果。

- 影视制作:支持场景草图、动画片段的快速生成,加速影视项目的前期制作流程,降低成本。

- 新闻与媒体:新闻机构可生成动画视觉效果,提升报道的感染力与观众互动感。

☞☞☞☞☞☞ 一键启动包在右侧下载 ☞☞☞☞☞☞

视频介绍

快速上手指南

AI工具已经被打包成一键启动的版本,只需轻轻点击即可使用,无需再为环境配置中的各种问题烦恼,一切变得更加便捷高效。

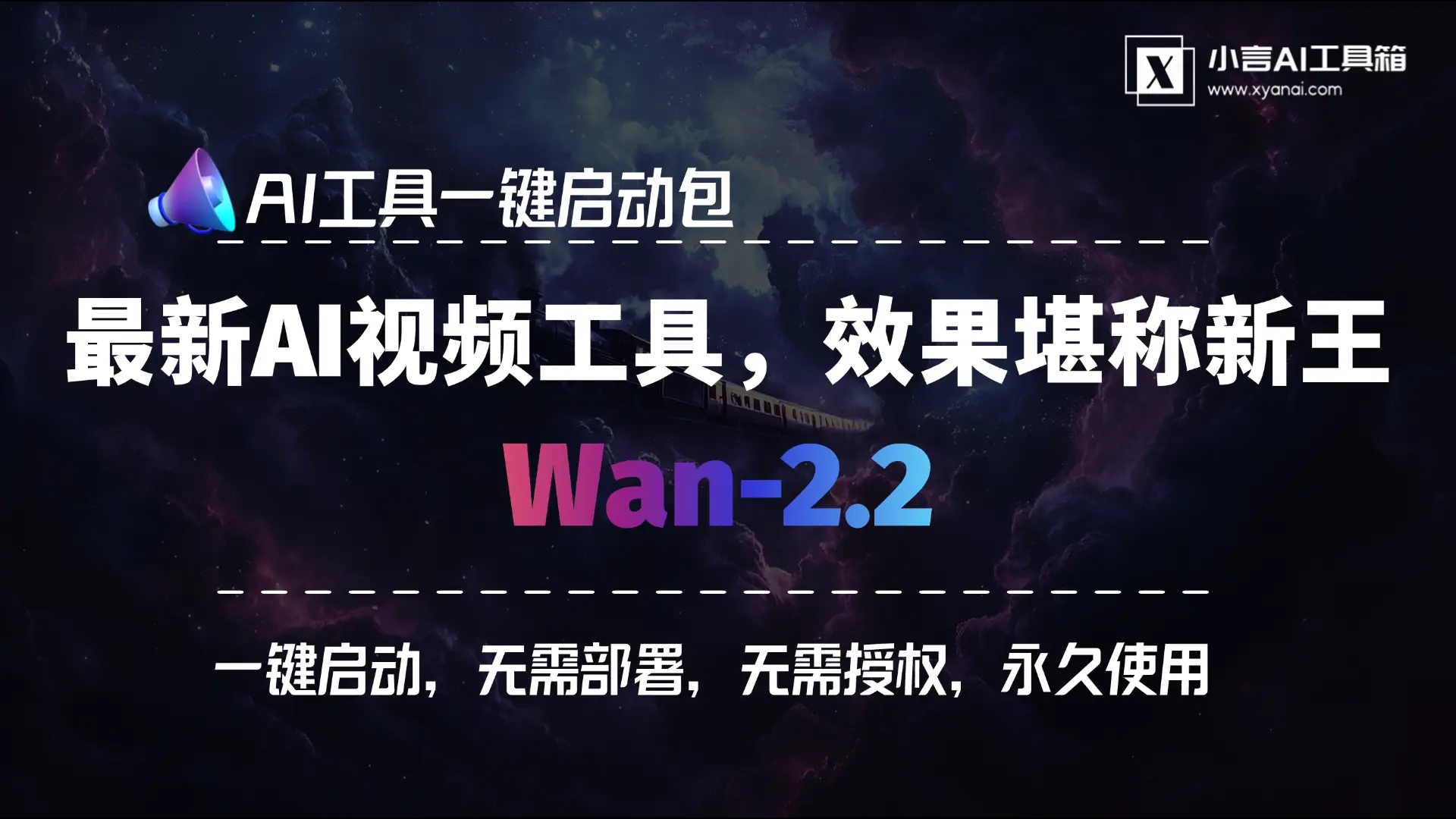

电脑配置要求

- 操作系统:Windows 10/11 64位

- 内存:32G以上

- 显卡:至少16G及以上显存的英伟达(NVIDIA)显卡

- CUDA:显卡驱动更新到最新后,支持的CUDA版本大于等于12.8版本。一般不用自己安装CUDA,如提示报错再打开此链接有详细教程:https://www.xyanai.com/84.html

- 整个包解压完约33.7G,要留足硬盘空间

- 如果电脑配置不满足要求的话,点我使用4090最强性能运行!

如何查看显卡品牌型号和显存:

- 打开任务管理器

- 点击“性能”

- 点击“GPU”

- 右上角可以看到显卡型号,下方可以看到显存大小

使用教程:

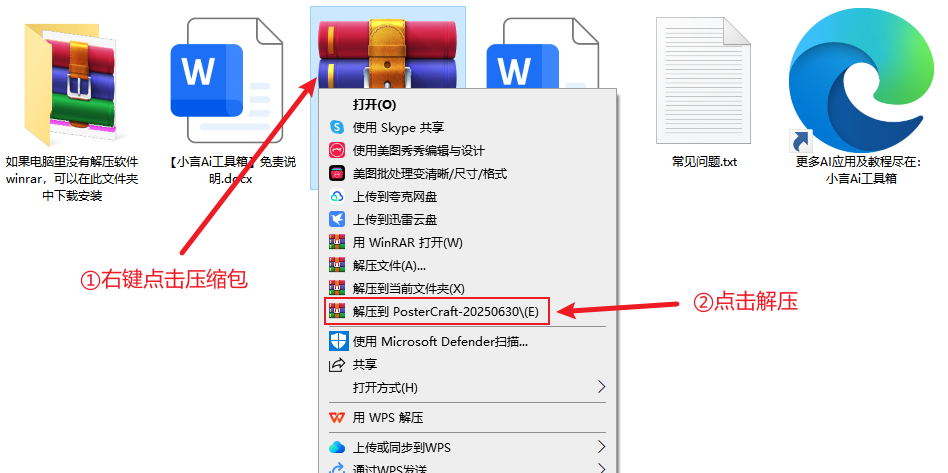

① 打开下载页面(https://www.xyanai.com/2087.html)点击页面右侧下载按钮,下载整合包之后解压,建议使用winrar解压(解压软件在文件包中,或者可以自己下载安装,下载地址:https://www.winrar.com.cn/)

不要用Windows自带解压!!不要用360解压!!

注意:文件夹路径和文件名称(包括音频、图片、视频等文件名称)不要出现中文字符,否则部分软件会因识别不出而报错

![]()

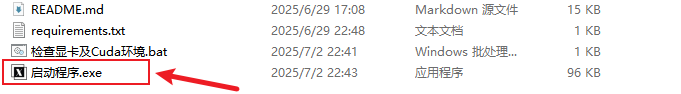

② 双击“启动程序.exe”,稍等片刻会在浏览器中自动打开操作界面

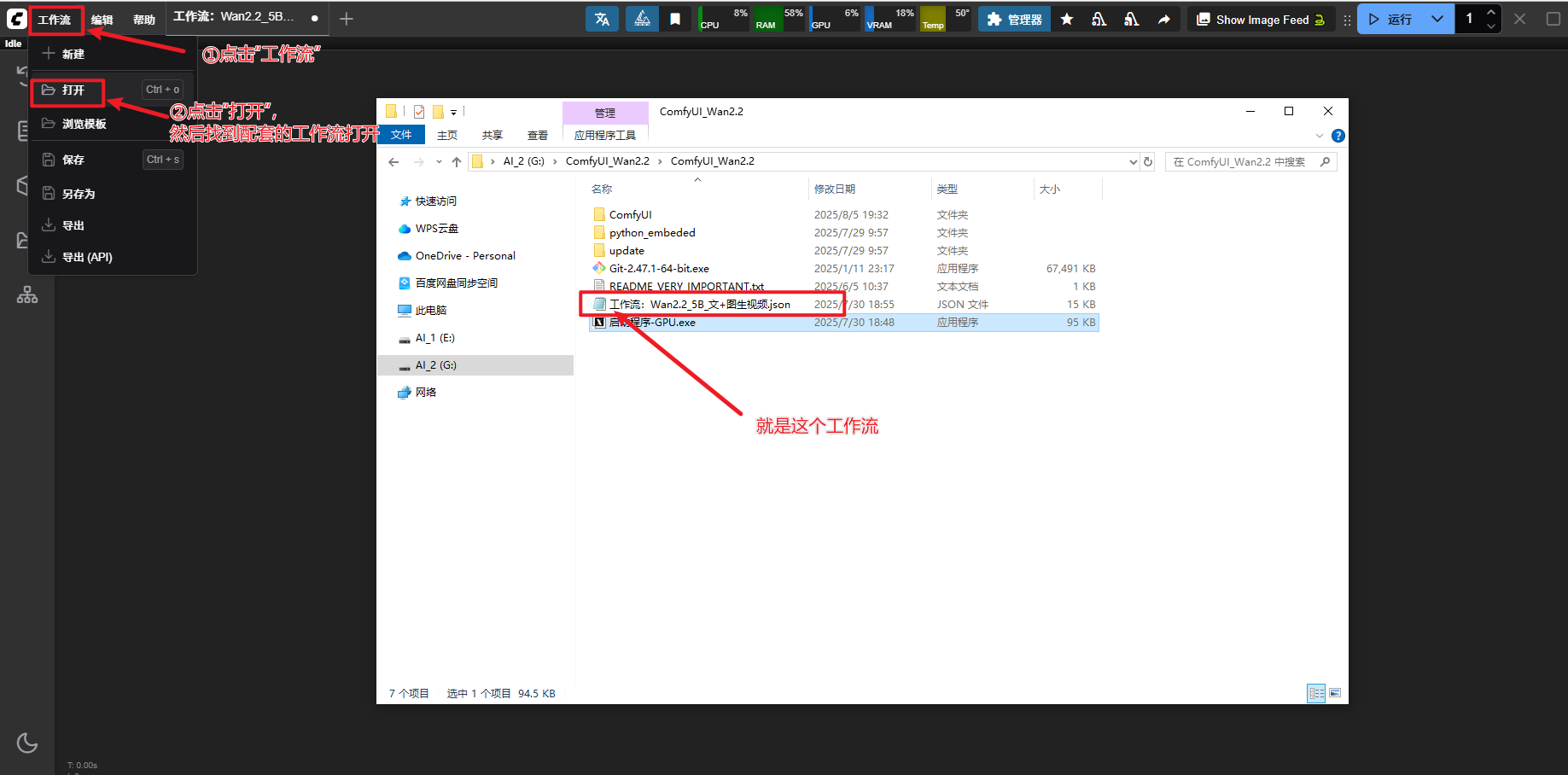

③点击左上角“工作流”,点击“打开”,打开入整合包配好的工作流

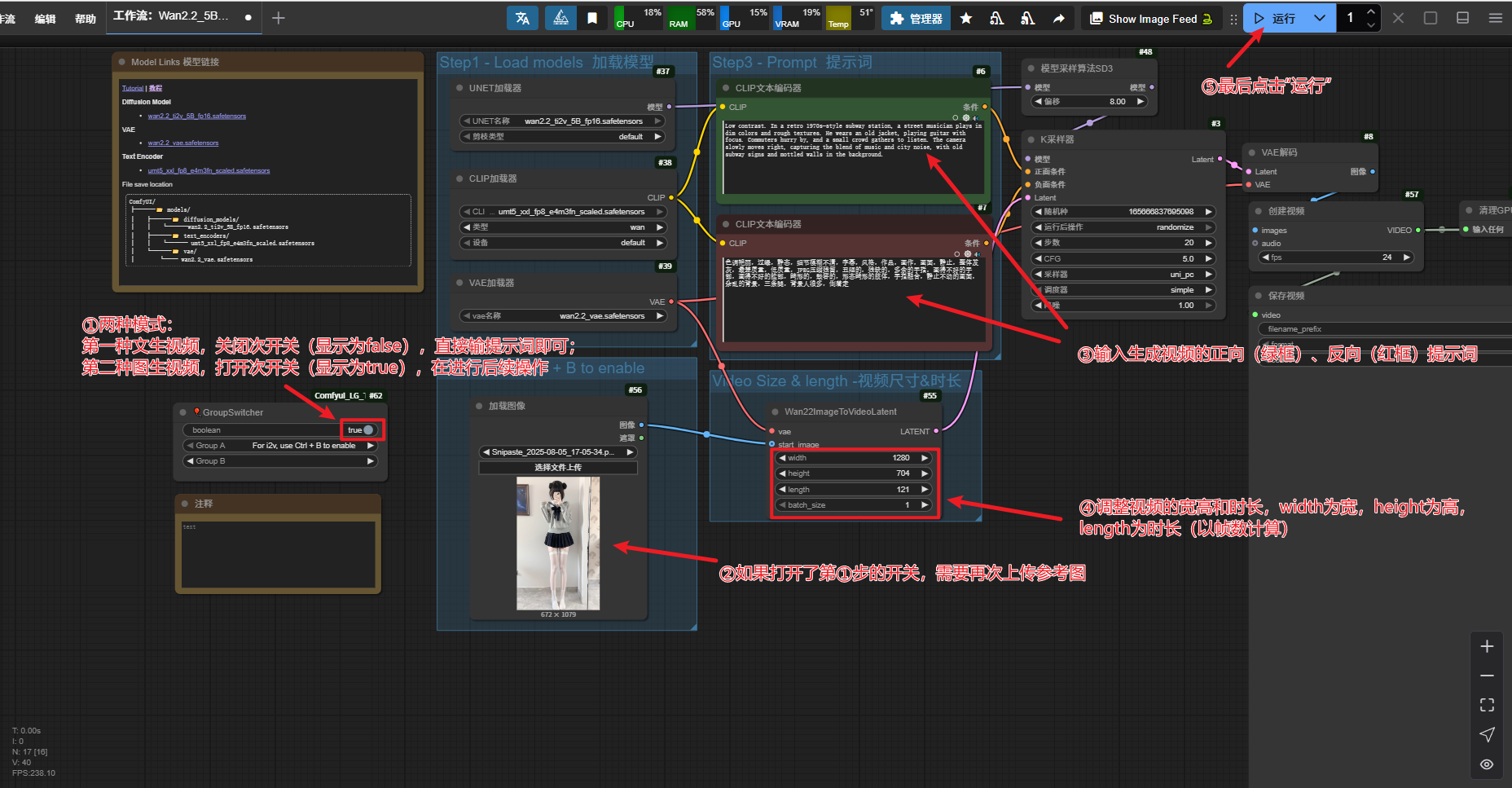

④如果是文生视频,则保持左侧的开关关闭,直接输入提示词即可。如果是图生视频,就把开关打开,然后上传图片,填写提示词,调整视频宽高及时长,最后点击“运行”。

生成结果:

总结

通义万相Wan-2.2是阿里巴巴开源的AI视频生成模型,支持文本、图片和文本+图片生成视频,具备电影级美学控制能力。它采用混合专家架构结合扩散模型与高压缩率3D VAE,不仅提升了生成质量,也能在消费级显卡上高效运行。Wan-2.2适用于短视频、广告、教育、影视等多个领域,目前已在多个平台开放下载和使用。